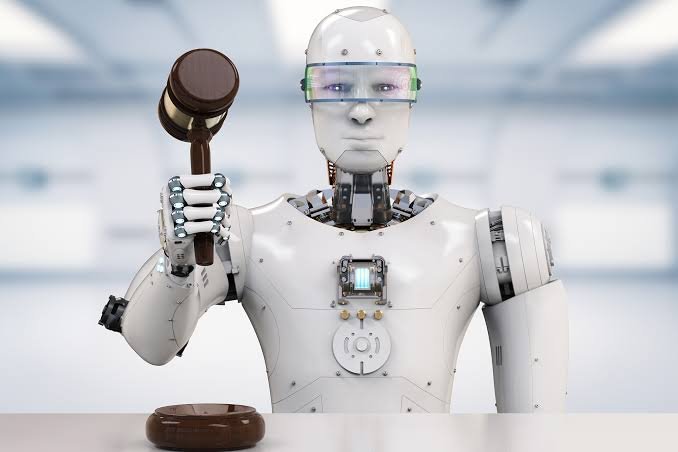

الذكاء الاصطناعي في قفص الاتهام: هل يمكن للآلات أن تحكم؟

هل يمكن للذكاء الاصطناعي أن يصبح قاضياً؟

مستقبل العدالة: هل يستطيع الذكاء الاصطناعي أن يحل محل القضاة؟

1. مقدمة:

يشهد العالم اليوم تزايداً ملحوظاً في استخدامات الذكاء الاصطناعي في مختلف القطاعات، ولم يعد المجال القانوني بمنأى عن هذه التطورات المتسارعة. فقد أظهر الذكاء الاصطناعي قدرة متزايدة على أتمتة المهام وتعزيز الكفاءة في العديد من جوانب الممارسة القانونية . ومع هذا الانتشار الواسع، يثار تساؤل جوهري حول إمكانية تطور الذكاء الاصطناعي ليقوم بدور أكثر حساسية وتعقيداً، وهو دور القاضي. هذا السؤال يثير نقاشات واسعة بين القانونيين وخبراء الذكاء الاصطناعي وعامة الجمهور على حد سواء . يسعى هذا التقرير إلى تحليل مدى إمكانية وصول الذكاء الاصطناعي إلى مستوى يمكنه من تولي مهام القضاء، وذلك من خلال استعراض التطبيقات الحالية للذكاء الاصطناعي في المجال القانوني، وتقييم قدرته على التفكير القانوني، وتحديد القيود والتحديات الأخلاقية والتقنية التي تواجهه، بالإضافة إلى استعراض آراء الخبراء في هذا الشأن.

2. المشهد الحالي للذكاء الاصطناعي في القانون:

يشهد المجال القانوني بالفعل استخداماً متزايداً لأدوات الذكاء الاصطناعي في مجموعة متنوعة من المهام التي تهدف إلى تحسين الكفاءة والدقة .

البحث القانوني:

تعمل أدوات الذكاء الاصطناعي على إحداث ثورة في عملية البحث القانوني من خلال قدرتها على تحليل كميات هائلة من البيانات القانونية بسرعة فائقة، وتحديد القوانين والسوابق القضائية واللوائح ذات الصلة . تستخدم أدوات مثل ROSS Intelligence و LexisNexis معالجة اللغة الطبيعية لتفسير الاستعلامات وتقديم نتائج بحث متقدمة .

كما يمكن للذكاء الاصطناعي تلخيص المعلومات من مصادر متعددة بسرعة كبيرة . وقد قامت منصات مثل Westlaw و Lexis بدمج تقنيات الذكاء الاصطناعي في خدماتها .

تحليل ومراجعة المستندات:

يُستخدم الذكاء الاصطناعي على نطاق واسع لأتمتة المهام الروتينية مثل مراجعة العقود والمستندات القانونية واكتشاف الأدلة الإلكترونية، مما يزيد من الكفاءة والدقة . يمكن للذكاء الاصطناعي استخلاص المعلومات الرئيسية وتحديد الأنماط والإشارة إلى التناقضات في المستندات القانونية . وتُستخدم أدوات مثل Logikcull و Everlaw و Harvey AI في مراجعة المستندات المؤتمتة .

التحليلات التنبؤية:

يُوظف الذكاء الاصطناعي لتحليل بيانات القضايا السابقة والتنبؤ بالنتائج المحتملة للقضايا، مما يساعد المحامين على اتخاذ قرارات مستنيرة . يمكن للذكاء الاصطناعي التنبؤ باحتمالية كسب القضية أو خسارتها، والمبالغ المحتملة للأضرار، ومدة التقاضي . وتقوم شركات مثل Pre/Dicta و Theo AI بتطوير أدوات ذكاء اصطناعي للتنبؤ بنتائج التقاضي .

صياغة وإدارة العقود:

يمكن للذكاء الاصطناعي المساعدة في صياغة المستندات القياسية وإدارة العقود بكفاءة أكبر . يمكن لأدوات الذكاء الاصطناعي تحليل لغة المسودة مقارنة بمعايير السوق واتفاقيات المنظمة .

الامتثال وإدارة المخاطر:

يمكن لأنظمة الذكاء الاصطناعي مراقبة التغييرات التنظيمية وتحديث المعلومات الحيوية في الوقت الفعلي .

المساعدة الافتراضية وخدمة العملاء:

تُستخدم روبوتات الدردشة المدعومة بالذكاء الاصطناعي بشكل متزايد في مكاتب المحاماة للإجابة على الأسئلة الشائعة وتحسين خدمة العملاء .

إن هذه التطبيقات الحالية للذكاء الاصطناعي في القانون تشير إلى قدرته على معالجة وتحليل كميات كبيرة من المعلومات القانونية، وأتمتة المهام المتكررة، وتقديم رؤى مستندة إلى البيانات. هذا التطور يحرر المتخصصين القانونيين للتركيز على الأنشطة ذات القيمة الأعلى مثل التفكير الاستراتيجي وعلاقات العملاء والتحليل القانوني المعقد .

كما أن تبني الذكاء الاصطناعي المتزايد يعمل على تغيير نماذج الأعمال في مكاتب المحاماة وطريقة تقديم الخدمات القانونية، مما يتطلب من المهنيين القانونيين التكيف مع هذه التغييرات التكنولوجية .

3. إمكانات الذكاء الاصطناعي في التفكير القانوني:

يتجاوز دور الذكاء الاصطناعي في المجال القانوني مجرد معالجة البيانات، حيث تظهر إمكانات متزايدة لأداء مهام تتطلب تفكيراً قانونياً.

الاستدلال المنطقي:

تظهر تقنيات الذكاء الاصطناعي، وخاصةً المناهج العصبية الرمزية التي تجمع بين نماذج اللغة الكبيرة (LLMs) والاستدلال المنطقي القائم على القواعد، إمكانات واعدة في الاستدلال المنطقي في السياقات القانونية . يمكن لبرامج المنطق ترميز المفاهيم القانونية كقواعد وحقائق منظمة . وقد أظهرت نماذج اللغة الكبيرة مثل o1–preview من OpenAI أداءً محسناً في معايير الاستدلال .

فهم المبادئ القانونية:

يجري تطوير بعض أدوات الذكاء الاصطناعي بقدرة على التفكير القانوني المتقدم، مما يسمح لها بتحليل وفهم تعقيدات القضايا والحقائق القانونية .

تدعي أداة Alexi للذكاء الاصطناعي أنها تستخدم مجموعة من وكلاء الذكاء الاصطناعي المتخصصين لتقديم نتائج تحتوي على خصائص الاستدلال القانوني .

تحليل السوابق القضائية:

يمكن للذكاء الاصطناعي تحليل مجموعات بيانات واسعة من السوابق القضائية لتحديد أوجه التشابه في الحقائق والقضايا القانونية والنتائج، مما يساعد المحامين في العثور على سوابق ذات صلة . يمكن لخوارزميات التعلم غير الخاضع للإشراف تجميع المستندات القانونية المتشابهة معاً .

توليد الحجج القانونية:

تُظهر التجارب أن نماذج اللغة الكبيرة مثل ChatGPT يمكنها اقتراح حجج في مذكرة قانونية وصياغة شكاوى قانونية، مما يدل على قدرة أساسية على إنتاج حجج قانونية .

المساعدة في تطوير استراتيجية القضية:

يمكن لأدوات الذكاء الاصطناعي تحليل المستندات القانونية الرئيسية والسلطات القانونية لمساعدة المحامين في تحديد نقاط القوة والضعف والاستراتيجيات المحتملة في التقاضي .

يشير هذا التطور إلى أن الذكاء الاصطناعي يتجاوز معالجة البيانات الأساسية نحو مهام أكثر تعقيداً تتطلب عناصر من التفكير القانوني،

على الرغم من أن هذه القدرة لا تزال في مراحلها المبكرة.

إن تحسين قدرات الاستدلال في نماذج اللغة الكبيرة، مثل “سلسلة التفكير الخاصة” في نماذج مثل o1، يترجم إلى تحليل قانوني أكثر شمولاً ودقة .

كما أن دمج البنى القائمة على المعرفة وأنظمة الخبراء جنباً إلى جنب مع نماذج اللغة الكبيرة يهدف إلى تعزيز دقة وموثوقية الذكاء الاصطناعي في الخدمات القانونية من خلال توفير الوصول إلى الحقائق القانونية الموثقة .

4. قيود الذكاء الاصطناعي في فهم الفروق القانونية الدقيقة:

على الرغم من التقدم الملحوظ، لا يزال الذكاء الاصطناعي يواجه تحديات جوهرية في فهم تعقيدات السياق الإنساني والعواطف والتفسيرات الدقيقة المطلوبة غالباً في صنع القرارات القانونية.

نقص الفهم السياقي:

غالباً ما يكافح الذكاء الاصطناعي لفهم السياق الكامل للمواقف القانونية، مما يؤدي إلى استجابات غير ذات صلة أو مربكة، خاصة في الموضوعات القانونية المعقدة أو الدقيقة . قد يفهم الذكاء الاصطناعي اللغة القانونية التقنية بشكل أفضل من اللغة العامية المستخدمة بشكل شائع .

عدم القدرة على فهم العواطف:

يفتقر الذكاء الاصطناعي إلى الحدس والتعاطف البشري، وهما أمران حاسمان في الإجراءات القانونية التي تنطوي على عناصر شخصية أو عاطفية .

غالباً ما تتطلب الممارسة القانونية التعاطف والقدرة على بناء الثقة مع العملاء الذين يواجهون أزمات شخصية أو مهنية .

لا يمكن للذكاء الاصطناعي تكرار الذكاء العاطفي الضروري للمشورة القانونية .

تحديات في التفسيرات الدقيقة:

غالباً ما يتطلب التفسير القانوني مراعاة السوابق والعوامل الثقافية والولايات القضائية المحددة،

وهو ما قد لا يستوعبه الذكاء الاصطناعي بشكل كامل .

الاعتماد على البيانات واحتمالية التحيز:

يتم تدريب أنظمة الذكاء الاصطناعي على البيانات، ويمكن أن تؤدي التحيزات الموجودة في تلك البيانات إلى نتائج تمييزية أو غير دقيقة . قد تعكس البيانات التاريخية أوجه عدم المساواة المجتمعية، والتي يمكن للذكاء الاصطناعي أن يديمها .

محدودية الإبداع والحكم:

قد يفتقر الذكاء الاصطناعي إلى الإبداع والحكم المطلوبين للتفكير القانوني المعقد والتفكير خارج القواعد والبيانات المحددة .

خطر الهلوسة والأخطاء:

يمكن للذكاء الاصطناعي إنشاء قوانين سابقة غير صحيحة، أو اختلاق قضايا، أو الاستشهاد بسلطات قديمة، مما يستلزم رقابة بشرية دقيقة .

سلطت قضية ماتا ضد أفيانكا الضوء على خطر قيام الذكاء الاصطناعي بإنشاء قضايا وهمية .

على الرغم من التطورات، لا يزال الذكاء الاصطناعي يعاني من قصور في المجالات التي تتطلب حكماً بشرياً ذاتياً وذكاءً عاطفياً وفهماً عميقاً لتعقيدات السلوك البشري والمعايير المجتمعية، وهي أمور ضرورية لصنع القرارات القانونية. إن اعتماد الذكاء الاصطناعي على البيانات التاريخية يعني أن التحيزات الموجودة داخل النظام القانوني يمكن أن تتضخم عن غير قصد بواسطة خوارزميات الذكاء الاصطناعي، مما قد يؤدي إلى نتائج غير عادلة أو تمييزية .

كما أن الاعتماد المفرط على الذكاء الاصطناعي دون إشراف بشري يشكل مخاطر على دقة وموثوقية المشورة والقرارات القانونية، مما قد يؤدي إلى أخطاء ذات عواقب قانونية وخيمة . إن احتمال قيام الذكاء الاصطناعي بتوليد معلومات غير دقيقة يؤكد الدور الحاسم للخبرة القانونية البشرية في التحقق من مخرجات الذكاء الاصطناعي وضمان نزاهة العمليات القانونية.

5. الآثار الأخلاقية للذكاء الاصطناعي في الأدوار القضائية:

يثير نشر الذكاء الاصطناعي كقضاة اعتبارات أخلاقية بالغة الأهمية.

التحيز والإنصاف:

يمكن لخوارزميات الذكاء الاصطناعي المدربة على بيانات تاريخية متحيزة أن تديم وتضخم التحيزات المجتمعية القائمة، مما يؤدي إلى نتائج غير عادلة في صنع القرارات القضائية . وقد أظهرت خوارزميات التنبؤ بالحكم ميلاً للتوصية بأحكام أشد للمتهمين من الأقليات .

المساءلة والمسؤولية:

يعتبر تحديد المسؤول عن الأخطاء أو القرارات المتحيزة التي تتخذها أنظمة الذكاء الاصطناعي قضية أخلاقية مهمة . قد يكون من الصعب تحديد المسؤولية بين المطورين ومقدمي البيانات أو مستخدمي نظام الذكاء الاصطناعي .

الشفافية والقابلية للتفسير:

تعمل العديد من أنظمة الذكاء الاصطناعي كـ “صندوق أسود“، مما يجعل عمليات صنع القرار فيها صعبة الفهم والطعن، وهذا يمكن أن يقوض الثقة في النظام القضائي .

يمكن أن يؤثر نقص الشفافية على الإجراءات القانونية الواجبة .

الخصوصية وسرية البيانات:

يتطلب استخدام الذكاء الاصطناعي في الأدوار القضائية الوصول إلى كميات هائلة من المعلومات الشخصية الحساسة، مما يثير مخاوف بشأن أمن البيانات والخصوصية .

يشكل تخزين البيانات القانونية الحساسة في أنظمة الذكاء الاصطناعي مخاطر على سرية العملاء .

التأثير على الإجراءات القانونية الواجبة:

يمكن أن يؤثر نقص الشفافية واحتمالية التحيز في الذكاء الاصطناعي سلباً على الإجراءات القانونية الواجبة .

تآكل ثقة الجمهور:

يمكن أن يؤدي الاعتماد على الذكاء الاصطناعي “الصندوق الأسود” في القرارات القضائية دون ضمانات مناسبة إلى تقليل الشفافية وتآكل ثقة الجمهور في النظام القضائي .

الحفاظ على الكفاءة المهنية:

يقع على عاتق المحامين والقضاة واجب أساسي للتأهل في التكنولوجيا ذات الصلة بمهنتهم، بما في ذلك فهم فوائد ومخاطر الذكاء الاصطناعي .

إن الآثار الأخلاقية لاستخدام الذكاء الاصطناعي في الأدوار القضائية عميقة،

خاصة فيما يتعلق بالتحيز والمساءلة والشفافية،

وهي مبادئ أساسية للعدالة. إذا كانت أنظمة الذكاء الاصطناعي متحيزة أو كانت عمليات صنع القرار فيها مبهمة، فقد يؤدي ذلك إلى نتائج غير عادلة أو ظالمة، مما يقوض أسس النظام القانوني وثقة الجمهور. كما أن عدم وجود خطوط واضحة للمساءلة عن أخطاء الذكاء الاصطناعي في القرارات القضائية يمكن أن يؤدي إلى إضعاف قدرة النظام القانوني على ضمان العدالة وتوفير الإنصاف للأفراد المظلومين . ويتطلب دمج الذكاء الاصطناعي في صنع القرارات القضائية تطوير معايير أخلاقية وأطر قانونية شاملة لتوجيه استخدامه وتخفيف الأضرار المحتملة .

6. العقبات التقنية في تطوير قضاة الذكاء الاصطناعي:

يتطلب إنشاء أنظمة قضائية موثوقة وعادلة تعتمد على الذكاء الاصطناعي معالجة تحديات تقنية كبيرة.

متطلبات البيانات:

تتطلب أنظمة الذكاء الاصطناعي كميات هائلة من البيانات القانونية عالية الجودة وغير المتحيزة للتدريب، وهو ما قد يكون من الصعب الوصول إليه بسبب مخاوف الخصوصية وقضايا حقوق النشر .

يخضع استخدام الأعمال المحمية بحقوق الطبع والنشر لتدريب نماذج الذكاء الاصطناعي لإجراءات قانونية . يجب أن تتوافق البيانات المستخدمة في التدريب مع قوانين الخصوصية مثل CCPA و GDPR .

دقة وموثوقية الخوارزميات:

يمثل ضمان دقة وموثوقية خوارزميات الذكاء الاصطناعي في السيناريوهات القانونية المعقدة تحدياً تقنياً كبيراً .

يمكن لنماذج الذكاء الاصطناعي أن تظهر “هلوسات” وتنتج نتائج غير صحيحة أو مضللة . قد تواجه أنظمة الذكاء الاصطناعي صعوبة في فهم العلاقات السابقة بين القضايا .

شفافية الخوارزميات وقابليتها للتفسير:

تجعل طبيعة “الصندوق الأسود” للعديد من خوارزميات الذكاء الاصطناعي من الصعب فهم كيفية توصلها إلى القرارات، مما يعيق الثقة والمساءلة . تتطلب المتطلبات القانونية بشكل متزايد أن تكون أنظمة الذكاء الاصطناعي شفافة وقراراتها قابلة للتفسير .

التعامل مع الدقة والغموض في اللغة القانونية:

غالباً ما تكون اللغة القانونية دقيقة ويمكن أن تخضع لتفسيرات متعددة، مما يشكل تحدياً للذكاء الاصطناعي لفهمها وتطبيقها بشكل صحيح .

مواكبة التغييرات القانونية:

تتطور القوانين باستمرار، مما يتطلب تحديث أنظمة الذكاء الاصطناعي باستمرار لتعكس القوانين واللوائح والتفسيرات القضائية الجديدة .

ضمان أمن البيانات:

يعتبر حماية البيانات القانونية الحساسة التي تستخدمها أنظمة الذكاء الاصطناعي من الانتهاكات والوصول غير المصرح به أمراً بالغ الأهمية .

دمج الذكاء الاصطناعي مع الأنظمة القانونية الحالية:

قد يكون دمج تقنيات الذكاء الاصطناعي الجديدة مع الأنظمة المعقدة والقديمة غالباً المستخدمة في المجال القانوني أمراً صعباً من الناحية التقنية .

إن التحديات التقنية في تطوير ذكاء اصطناعي يمكنه أداء المهام القضائية بشكل موثوق وعادل كبيرة، خاصة في الحصول على بيانات عالية الجودة وضمان دقة وشفافية الخوارزميات والتعامل مع تعقيدات اللغة والاستدلال القانونيين.

إن نقص الشفافية في خوارزميات الذكاء الاصطناعي يمكن أن يعيق تبنيها في الأدوار القضائية لأنه يقوض مبادئ الإجراءات القانونية الواجبة والقدرة على فحص القرارات والطعن فيها . ولكي يتم قبول الذكاء الاصطناعي في البيئات القضائية، فإنه يحتاج إلى تقديم تفسيرات واضحة ومفهومة لمنطقه، مما يسمح للمهنيين القانونيين والجمهور بالثقة في أحكامه. ويتطلب معالجة التحديات التقنية بحثاً وتطويراً مستمرين في مجال الذكاء الاصطناعي، بالإضافة إلى التعاون بين الخبراء القانونيين وعلماء الكمبيوتر وصانعي السياسات لوضع معايير وأفضل الممارسات لاستخدام الذكاء الاصطناعي في المجال القانوني .

7. وجهات نظر الخبراء حول قضاة الذكاء الاصطناعي:

تتنوع آراء الخبراء من علماء القانون وعلماء الذكاء الاصطناعي وشخصيات قضائية حول مدى جدوى ورغبة تولي الذكاء الاصطناعي لمسؤوليات قضائية.

التشكيك في إمكانية استبدال القضاة البشريين:

يعتقد العديد من الخبراء أن الحكم البشري والتقدير والذكاء العاطفي لا غنى عنهم في صنع القرارات القضائية العادلة ولا يمكن تكرارها بالكامل بواسطة الذكاء الاصطناعي .

يتوقع رجال القانون أن الذكاء الاصطناعي سيغير العمل القضائي لكنه يشك في أنه سيحل محل القضاة البشريين بسبب الحاجة إلى تقدير دقيق . ويعتقد ستة وتسعون بالمائة من المهنيين القانونيين أن السماح للذكاء الاصطناعي بتمثيل العملاء في المحكمة سيكون “خطوة بعيدة المدى” .

إمكانية مساعدة الذكاء الاصطناعي للقضاة:

يرى بعض الخبراء أن الذكاء الاصطناعي أداة قيمة لمساعدة القضاة البشريين من خلال تحسين الكفاءة والوصول إلى المعلومات وربما تقليل التحيز، لكن ليس كبديل لهم . يمكن للذكاء الاصطناعي المساعدة في إدارة كميات هائلة من البيانات وتسريع تسوية القضايا . كما يمكن لأدوات الذكاء الاصطناعي المساعدة في تحديد التحيز اللاواعي في صنع القرارات القضائية .

مخاوف بشأن التحيز ونقص الإنسانية:

يثير الخبراء مخاوف بشأن احتمالية أن يرث الذكاء الاصطناعي ويضخم التحيزات من بيانات التدريب ونقصه في التعاطف والفهم البشريين .

إن افتقار الذكاء الاصطناعي للإنسانية يعني أنه قد لا يكون قادراً أبداً على اتخاذ قرارات قضائية تتطلب التقدير والتعاطف .

التفاؤل بشأن الفوائد المحتملة للذكاء الاصطناعي:

يجادل بعض المؤيدين بأن الذكاء الاصطناعي يمكن أن يحسن عدالة وموضوعية الأحكام من خلال اتباع السوابق بدقة ومنع التحيزات الشخصية .

لا يحتاج قضاة الذكاء الاصطناعي إلى فترات استراحة ويمكنهم زيادة كفاءة المحاكم .

التأكيد على الإشراف البشري:

يتفق العديد من الخبراء على أنه حتى مع الذكاء الاصطناعي المتقدم، فإن الإشراف البشري والتحقق ضروريان لضمان الدقة والامتثال الأخلاقي وجودة العمل القانوني .

الرأي السائد بين الخبراء هو أنه على الرغم من أن الذكاء الاصطناعي لديه القدرة على مساعدة السلطة القضائية بشكل كبير في مهام مختلفة، فمن غير المرجح أن يحل محل القضاة البشريين بالكامل في المستقبل القريب بسبب الدور الحاسم للحكم البشري والتعاطف والاعتبارات الأخلاقية.

8. المسار المستقبلي للذكاء الاصطناعي في السلطة القضائية:

من المتوقع أن يستمر الذكاء الاصطناعي في النمو والتأثير على مهنة القانون في السنوات القادمة، مع تزايد تبني الأدوات التي تعمل بالذكاء الاصطناعي . من المرجح أن يركز المستقبل القريب على استمرار الذكاء الاصطناعي كأداة لمساعدة القضاة البشريين والمهنيين القانونيين في مهام مثل البحث وتحليل المستندات وإدارة القضايا . قد تجد تقنيات الذكاء الاصطناعي المزيد من التطبيقات في مجالات محددة من العملية القضائية، مثل التنبؤ بنتائج القضايا، وتقييم مخاطر العودة إلى الإجرام لأغراض إصدار الأحكام، أو في تسوية المنازعات عبر الإنترنت للقضايا الأبسط .

إن التطورات المستمرة وتحسين قدرات الذكاء الاصطناعي، خاصة في مجال التفكير القانوني وفهم السياق البشري، يمكن أن توسع دوره في المستقبل، لكن لا تزال هناك عقبات تقنية وأخلاقية كبيرة . سيعتمد مستقبل الذكاء الاصطناعي في السلطة القضائية على تطوير وتنفيذ مبادئ توجيهية أخلاقية وأطر قانونية قوية لضمان الاستخدام المسؤول وتخفيف المخاطر . وحتى مع وجود ذكاء اصطناعي أكثر تقدماً، من المرجح أن يظل الإشراف البشري ضرورياً لضمان العدالة والدقة والمساءلة في العمليات القضائية .

يبدو أن السيناريو الأكثر احتمالاً هو نموذج تعاوني حيث تعزز أدوات الذكاء الاصطناعي قدرات القضاة البشريين، بدلاً من استبدالهم بالكامل، مما يسمح بزيادة الكفاءة والوصول إلى المعلومات مع الحفاظ على العناصر البشرية الأساسية في الحكم والتعاطف.

9. خاتمة:

يقدم هذا التقرير تحليلاً شاملاً لإمكانية أن يصبح الذكاء الاصطناعي قاضياً. في حين أن الذكاء الاصطناعي قد أظهر بالفعل قدرات كبيرة في مساعدة المهنيين القانونيين في مجموعة متنوعة من المهام، إلا أن هناك قيوداً فنية وأخلاقية كبيرة تمنع استبدال القضاة البشريين بالكامل في المستقبل القريب. إن الافتقار إلى الفهم السياقي والذكاء العاطفي والقدرة على التعامل مع القضايا القانونية المعقدة والدقيقة، بالإضافة إلى المخاوف بشأن التحيز والمساءلة والشفافية، كلها عوامل تجعل من غير المرجح أن يتولى الذكاء الاصطناعي دور القاضي بشكل كامل.

ومع ذلك، من الواضح أن الذكاء الاصطناعي سيستمر في لعب دور متزايد الأهمية في النظام القانوني. فمن المرجح أن يصبح أداة لا تقدر بثمن لمساعدة القضاة والمحامين في البحث القانوني وتحليل المستندات والتنبؤ بنتائج القضايا. إن التركيز المستقبلي سينصب على تطوير “الذكاء المشترك” حيث يعمل الخبراء البشريون وقوة التحليل للذكاء الاصطناعي معاً لتعزيز صنع القرار في المجال القانوني.

في الختام، على الرغم من الإمكانات التحويلية للذكاء الاصطناعي، فإن الحكم البشري والاعتبارات الأخلاقية ستظل ذات أهمية قصوى في إدارة العدالة. من المرجح أن يخدم الذكاء الاصطناعي كأداة قوية لتعزيز قدرات القضاة البشريين بدلاً من استبدالهم بالكامل، مما يضمن الحفاظ على مبادئ العدالة والإنصاف وثقة الجمهور في النظام القانوني.